概要

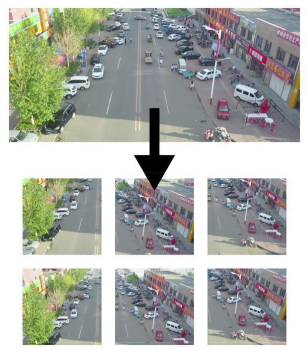

・監視アプリケーションにおいて、シーン内の小さな物体や遠くの物体を検出することは大きな課題となっています

・このような物体は、画像中の少ない画素数で表現されているため、従来の検出器では検出が困難であした

・本研究では、小物体検出のための汎用的なスライス補助推論と微調整するパイプラインを提供するSAHI(Slicing Aided Hyper Inference)と呼ばれるオープンソースのフレームワークを提案します

・VisdroneとxViewの空中物体検出データセットの物体検出ベースラインを用いた実験評価により、提案する推論手法はFCOS、VFNet、TOOD検出器に対して、それぞれ6.8%、5.1%、5.3%の物体検出APを向上させることができました

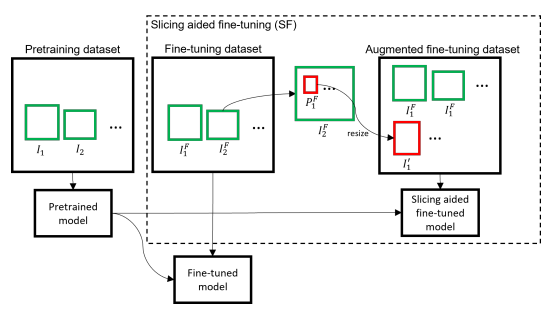

Slicing Aided Fine-tuning(SF)

物体検出でよく使われるYOLOv5などのフレームワークは、ImageNetやMs COCOなどのデータセットで事前に学習した重みを使用します。これにより、一から学習するより、短い学習スパンで、モデルをファインチューニングすることが可能になります。

これらのデータセットには、低解像度(640×480)が多く含まれ、画像に対して、大きい範囲をカバーするオブジェクト(平均で画像の高さの60%をカバー)を持ちます。これらのデータセットを用いて事前学習したモデルは、類似した入力に対して非常に優れた検出性能を発揮する。一方で、ハイエンドのドローンや監視カメラで撮影された高解像度画像における小物体検出タスクでは、精度が著しく低下することが判明しました。そこで、スライスを利用したデータ拡張を行います。

まず、今回使用するデータセット(Fine-tuning dataset)の画像IFに対して、寸法M×Nで切り取ります(PF)。切り取りは、オバーラップしながらスライスしていきます。そして、切り取られた画像PFは、アスペクト比を保ったまま、元画像程度の大きさにリサイズされます。これにより、元の画像に比べて、相対的にオブジェクトサイズが大きくなった画像I’を得ることができます。この画像I’は元の画像Iと共にファインチューニングに使用されます。ただし、切り取る画像のサイズを小さくしすぎると、大きな物体がスライス内に収まらなくなり、大きな物体に対する検出精度が低下する可能性があります。

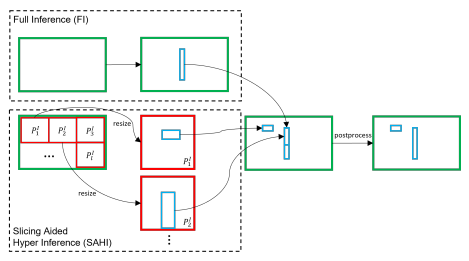

Slicing Aided Hyper Inference(SAHI)

スライス法は推論の時も利用します。まず、元画像IをM×Nのサイズでオーバーラップありで、スライスする。スライスされた画像PIは、アスペクト比を保ったままリサイズされます。その後、各画像に対して、検出を行います。大きな物体を検出するために、オプションで、元画像を用いた推論(full-inference: FI)を適用することが来ます。最後に、スライス画像に対する予測結果と、FIを使用する場合は、NMSを使用して元のサイズにマージされます。